Rotterdamse aanslagen: Waarom nóg meer camera’s ondermijnend werken

Rotterdam wordt al heel 2023 opgeschrikt door aanslagen op woonhuizen, waarschijnlijk voortkomend uit ruzies tussen drugscriminelen. Wat kan de politie daaraan doen en kan de inzet van technologische oplossingen zoals slimme camera’s, kunstmatige intelligentie en algoritmes daarbij helpen? Hoogleraar Digitale surveillance Marc Schuilenburg denkt van niet. Het kan zelfs averechts werken, omdat dit soort technologieën het vertrouwen van de burgers juist kunnen beschadigen.

De politie lijkt tot nu toe fysiek weinig te kunnen doen aan al die explosies in de stad. In hoeverre kan digitale surveillance een bijdrage leveren aan het stoppen van die aanslagen?

“De preventieve werking van camera’s is heel gering, blijkt uit onderzoek. Daarnaast is hier het grote probleem dat het steeds diffuser is geworden waar je wil filmen. Twintig jaar geleden kon je een straat waar een crimineel woonde in de gaten houden, nu gaat het om een heel netwerk van familie en vrienden die worden bedreigd en die overal wonen. Dus als je het over digitale surveillance hebt, dan heb ik daar weinig vertrouwen in.”

In wat voor surveillance dan wel?

“De analoge, de menselijke. Waarbij agenten een relatie opbouwen met mensen in de wijk, die kunnen dan dingen zien en doorgeven of zelfs ingrijpen. Maar daarvoor is wel vertrouwen in de politie nodig, en dat is een groot probleem. In wijken als Hillesluis en Bloemhof ligt het vertrouwen van de burger in de politie veel lager dan het landelijk gemiddelde. Als je de Nederlandse bevolking vraagt: heeft u vertrouwen in de politie of heeft u daar een goede band mee, dan zegt landelijk zo’n 70 procent ‘ja’, in die wijken ligt dat rond de 50 procent. En dat heeft consequenties voor de informatiepositie van de politie in zo’n wijk, wat het voorkomen van deze aanslagen bemoeilijkt.”

Marc Schuilenburg is hoogleraar Digitale surveillance aan de Erasmus Universiteit en universitair docent Criminologie aan de Vrije Universiteit. Hij schreef meerdere boeken over veiligheid, zoals The Securization of Society (2015).

‘Om criminaliteit te voorkomen heb je veel meer aan de menselijke factor, maar die wordt juist ondermijnd door die nadruk op technologie’

Tegelijk zie je dat er overal steeds meer camera’s komen te hangen, dat wekt de indruk dat de politie meer vertrouwen heeft in camera’s dan in de eigen wijkagent met goede connecties in de wijk.

“Ja, voor alle duidelijkheid: camera’s kunnen wel degelijk nut hebben in de opsporing van de daders, hoewel je dan natuurlijk al wel te laat bent, dan is de explosie al geweest. Maar het idee is hardnekkig dat je met camera’s criminaliteit kunt voorkomen. Je ziet een toenemende datadrang en technologiedrift bij de politie. Dat zou je een soort surveillance solutionisme kunnen noemen: het geloof in digitale technologie als de oplossing voor het veiligheidsvraagstuk. Maar om criminaliteit te voorkomen heb je veel meer aan de menselijke factor, maar die wordt juist ondermijnd door die nadruk op technologie.”

Waarom werkt dat ondermijnend?

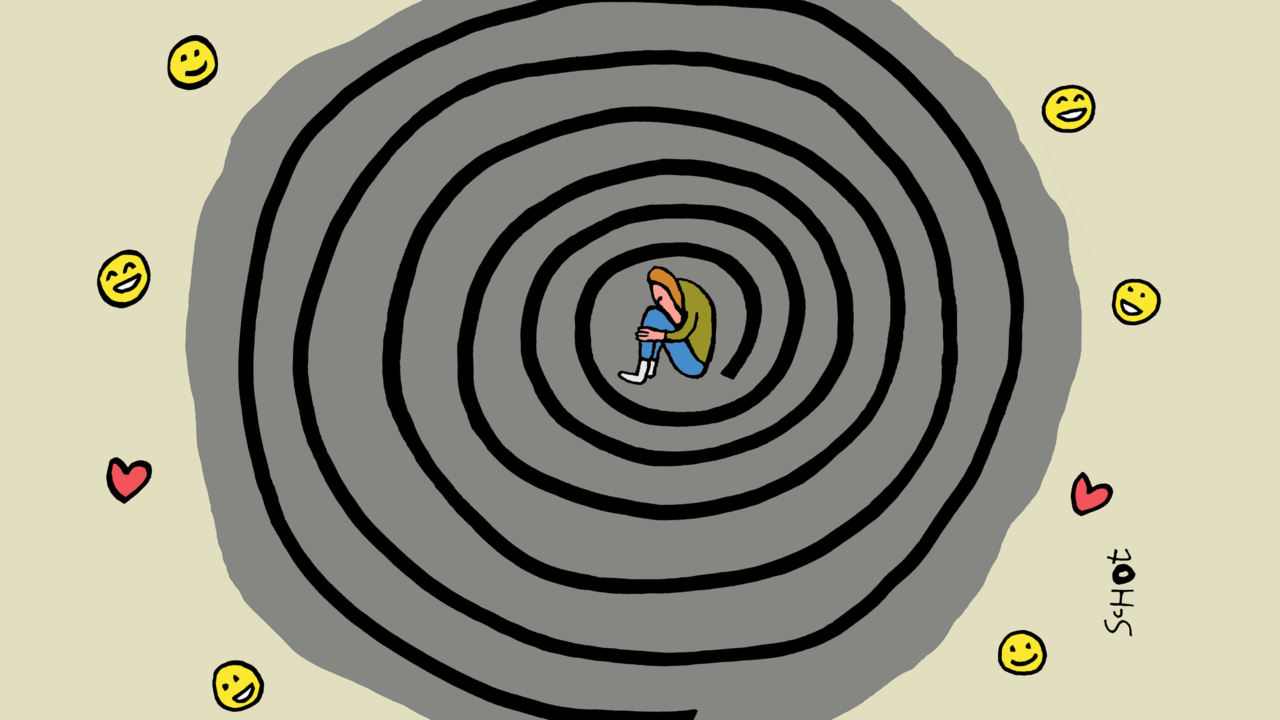

“Door alleen te vertrouwen in digitale vormen van surveillance delegeer je als het ware je verantwoordelijkheid naar de technologie. Daarin schuilt het gevaar dat wijkbewoners minder op elkaar gaan letten, met het gevolg dat de sociale cohesie vermindert en daarmee de onderlinge controle. Terwijl juist sociale controlemechanismen belangrijk zijn in de strijd tegen criminaliteit. Daarnaast heeft de politie vertrouwen van wijkbewoners nodig. Vertrouwen heeft te maken met de menselijke kanten van politieoptreden. Zaken als etnisch profileren en discriminerende algoritmes in digitale opsporingstools om fraude met sociale voorzieningen op te sporen, schaden het vertrouwen alleen maar.”

Als je over een willekeurige straat in, laten we zeggen, Rotterdam-Zuid loopt, hoeveel camera’s zijn daar dan eigenlijk?

“Dat is ongelooflijk. Het zijn niet alleen de camera’s van de politie, ook camera’s in jouw en mijn telefoon, beveiligingscamera’s van ondernemers, in auto’s en op vuilnisbakken. Denk ook aan de enorme toename in het gebruik van slimme deurbellen, daar zit ook een bewakingscamera in. Je bent volledig omringd door camera’s, we leven in een soort glazen huis.”

Afbeelding door: Bas van der Schot

In hoeverre kan de politie daar allemaal bij?

“Heel gemakkelijk als het gaat om deze explosies. Als de politie denkt dat de beelden helpen bij de opsporing van de daders kan ze die beelden vorderen, zowel van deurbellen als van telefoons. Bij de explosies in de Van Speijkstraat en de Crooswijkseweg is dat waarschijnlijk ook gebeurd.”

Er is de laatste maanden veel te doen over de stormachtige ontwikkeling van kunstmatige intelligentie. Welke rol speelt AI al in digitale surveillance?

“Vroeger was surveillance analoog, kijken en bekeken worden gebeurde met ons blote oog. Toen werd het digitaal, met de camera en gezichtsherkenning. En nu komen algoritmes hier overheen. Zo worden beelden gehaald uit allerlei verschillende datasets. Om die beelden bij elkaar te brengen en te analyseren worden algoritmes en kunstmatige intelligentie ingezet. Het gebruik van algoritmes in de opsporing brengt allerlei gevaren met zich mee, dat zag je bijvoorbeeld bij het fraude-opsporingssysteem SyRI (dat ‘bijstandsfraude’ signaleerde op basis van profielen, red.), en de Toeslagenaffaire. Bij die zaken was sprake van algoracisme.”

Worden zulke systemen ook gebruikt bij de politie?

“De politie werkt onder andere met CAS, het Criminaliteit Anticipatie Systeem. Dat is een systeem waarmee ze hopen te voorspellen waar en wanneer ergens criminaliteit plaatsvindt om daar vervolgens de inzet van surveillanten op af te stemmen. Probleem is dat er geen enkel wetenschappelijk bewijs is dat het werkt. In Chicago werkt de politie nu met een systeem die dat niet alleen op buurtniveau voorspelt, maar ook wie de eventuele dader en het eventuele slachtoffer kan worden. De Nederlandse politie is hier erg in geïnteresseerd.”

Dat klinkt heel eng. Kan zo’n systeem wel zomaar in Nederland onder de strengere Europese privacywetgeving?

“De inlichtingendiensten van de politie zitten voortdurend op social media te profileren en in het geheim data te verzamelen. Een goede wettelijke basis hiervoor is er helemaal niet. Tegelijkertijd is er in het Europees Parlement wel net een nieuwe wet op AI aangenomen, de zogeheten AI-Act, die onder andere biometrische gezichtsherkenning op straat verbiedt, met uitzonderingen voor bepaalde dreigingen, zoals het gevaar van een terroristische aanslag. Het is goed dat Europa hier een voortrekkersrol in speelt, en dat de wetgeving hier veel strikter is dan in de VS of China.”

Hoe werkt zo’n systeem in Chicago precies?

“Het maakt een heat list met behulp van big data-technieken, waarbij een algoritme een risicoscore berekent op basis van datasets van de politie zelf en openbare gegevens over buurten en inwoners. Die combinatie van die data extrapoleren ze om te komen tot iemand die een potentiële dader of slachtoffer is.”

‘Mijn verwachting is dat uiteindelijk dat vooruitkijken steeds minder belangrijk wordt, en het terugkijken en real-time kijken steeds meer’

Dus als je toevallig op al die punten heel erg lijkt op een crimineel, maar nooit iets verkeerd doet, dan kun je toch aangemerkt worden als crimineel?

“Ja, en dat is al heel vaak gebeurd met dat soort systemen. Ik zeg trouwens niet dat algoritmes nooit zin hebben. Je kunt er enorme successen mee boeken, zoals in de Encrochatzaak, waarin miljoenen berichtjes op telefoons van criminelen werden buitgemaakt en met algoritmes en netwerkanalyses werden doorzocht.

“Maar dat is terugkijken. Dat is iets heel anders dan vooruitkijken. Mijn verwachting is dat uiteindelijk dat vooruitkijken steeds minder belangrijk wordt, en het terugkijken en real-time kijken steeds meer. Want dat lukt wel en daarbij loop je ook minder grote ethische risico’s. Dat is een trendbreuk met wat lang gedacht werd in het maatschappelijk en wetenschappelijk debat, of bijvoorbeeld in sciencefictionfilms als Minority Report, want dat ging allemaal om vooruitkijken.”

Afbeelding door: Bas van der Schot

Is nu de conclusie dat de nadruk op technologische oplossingen geleid heeft tot een vermindering van vertrouwen in de politie?

“Niet op een causale manier. Vertrouwen in technologie kan leiden tot een afstand tot de mensen die je nodig hebt bij je politiewerk. Het lijkt erop dat bij de explosies in Rotterdam de politie vooral vertrouwt op techniek en minder op de inwoners in de buurt, terwijl je die vertrouwenspositie wel nodig hebt. Maar ons vertrouwen in de overheid is in gedrang gekomen door etnisch profileren en discriminerende algoritmes. Daarom moet de politie ook geen systemen inzetten die kunnen leiden tot discriminatie of etnische profilering.”

Lees meer

-

‘Andere criminaliteit verdwijnt uit beeld door focus op drugs’

Gepubliceerd op:-

De Kwestie

-

De redactie

-

Elmer Smaling

Elmer SmalingAdjunct-hoofdredacteur

Meest gelezen

-

Universiteiten willen dat minister Palestijnen helpt hierheen te komen

Gepubliceerd op:-

Nieuws

-

-

Hoe Femke na de dood van haar vader weer vreugde vond in een tekening

Gepubliceerd op:-

Mentale gezondheid

-

-

Van schermtijdboetes tot gameplatform tegen eenzaamheid: EUR-studenten organiseren grootste AI-studentenhackathon van Nederland

Gepubliceerd op:-

Campus

-

Kunstmatige intelligentie

-

Reacties

1 reactie

Reacties zijn gesloten.

Meer De Kwestie

-

Oorlog in Iran: krijgt de energietransitie een duw of een klap?

Gepubliceerd op:-

De Kwestie

-

-

Hoe dure festivaltickets en topconcerten de hele livemuzieksector bedreigen

Gepubliceerd op:-

De Kwestie

-

-

‘Gemeentes maken zich pas druk over problemen van jongeren als er veiligheidsproblemen bij komen kijken’

Gepubliceerd op:-

De Kwestie

-

Luuk op 25 mei 2023 om 17:08

Mooi stuk!